Google再与军方合作,AI伦理的边界在哪里?

故事要从今年三月初说起。

今年三月,Google被爆料已经与美国国防部(五角大楼)达成合作,帮助后者开发应用于无人机的人工智能系统,项目代号Project Maven。

消息一出,瞬间风起云涌,谷歌员工表达了对此项目的强烈不满。有员工认为Google在为五角大楼开放资源,助纣为虐般地帮助后者打造无人机监控技术;还有一部分人质疑Google如此使用机器学习技术是否符合道德标准,他们认为五角大楼会将这一技术用于杀伤性武器,进而带来技术乐观派们从未想要造成的伤害。

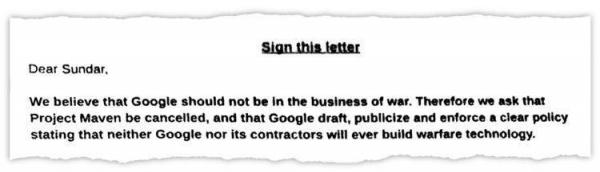

随后,谷歌超过3100名员工联名请愿,上书CEO桑达尔·皮查伊(Sundar Pichai),表达抗议。

谷歌员工联名上书Sundar Pichai

事情到四月底进一步发酵。有媒体发现,Google删掉了其沿用十八年的座右铭“Don't be evil”在公司行为守则开头中的三处强调。仅在准则的结尾,还留有未被删掉的一句:“记住,don't be evil,如果你看到了一些你认为不正确的事情,大声说出来!”

上周五,在每周一次的“天气预报”例会上,Google Cloud首席执行官黛安·格林(Diane Greene)宣布,Google将在这次合约到期后结束与美国国防部的合作的Project Maven。

这无疑是一件大事。“胜利的消息”在谷歌内部疯传。随着一篇篇报道的蜂拥而出,这件事情似乎暂时以谷歌“向员工妥协、停止与国防部续约”的方式得以落幕。

但就在今天,谷歌CEO Sundar Pichai发表了署名题为《AI at Google:our principles》的文章,列出7大指导原则,并指出谷歌并不会终止与美军的合作。谷歌的反转让人唏嘘,虽然其明确了“不会追求的AI应用”,但技术作恶还是人作恶的问题,AI伦理再次引人深思。

AI伦理的边界在哪里?

如果说谷歌近期来不太平,那么亚马逊Alexa的日子也不好过。

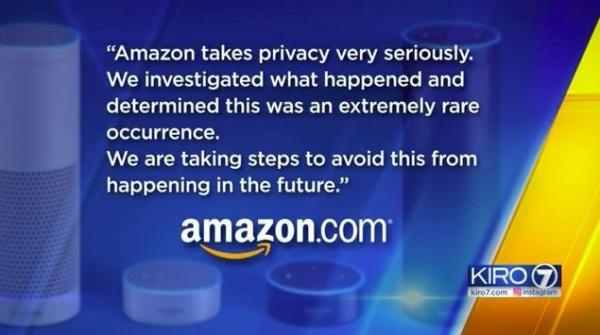

亚马逊的Echo设备被指控未经许可将私人对话录音,并将音频发送给用户联系人列表中的随机一位人士。这距离上次Alexa被爆出“嘲笑人类”事件的吓人事件,还没过过去多久。

Amazon对Alexa一事的回应

这可远远不是个例。早在2016年,一个人设为19岁少女、名为Tay的聊天机器人在推特上线。这个微软开发的人工智能采用了自然语言学习技术,能够通过抓取和用户互动的数据,处理并模仿人类的对话,像人一样用笑话、段子和表情包聊天。但是上线不到一天,Tay就被“调教”成了一个满口叫嚣着种族清洗、粗野不堪的极端分子,微软只好以“系统升级”为由将其下架。

图片新闻

最新活动更多

-

6月13日立即参评>> 【评选】维科杯·OFweek2025中国工业自动化及数字化行业年度评选

-

6月13日立即参评>> 【评选启动】维科杯·OFweek(第四届)2025汽车行业年度评选

-

6月13日立即参评 >> 【评选启动】维科杯·OFweek 2025(第十届)人工智能行业年度评选

-

7.30-8.1火热报名中>> 全数会2025(第六届)机器人及智能工厂展

-

7月31日免费预约>> OFweek 2025具身机器人动力电池技术应用大会

-

即日-2025.8.1立即下载>> 《2024智能制造产业高端化、智能化、绿色化发展蓝皮书》

推荐专题

- 1 【独家深度】2025年中国机器人激光雷达行业市场调研

- 2 人形机器人革命,NVIDIA如何破局?

- 3 《2025机器人+应用与产业链新一轮加速发展蓝皮书》电子版限免下载!

- 4 用信步工控主板,当行业冠军,“天工”机器人马拉松夺冠!

- 5 信步科技发布具身智能开发平台HB03,实现机器人“大、小脑融合”

- 6 【展商推荐】意优科技:专注于人形机器人关节模组的研发与生产

- 7 MOONLIGHT 玄晖成为全球首款获得 CE+ETL双认证的力控型并联机器人

- 8 纤尘不染|新时达众为兴洁净型SCARA机器人新品重磅发布

- 9 MiR 发布最新电子书,揭示AMR 革新医院物流全流程

- 10 【展商推荐】因时机器人:专注于微型精密运动部件研发制造和伺服控制技术突破创新

分享

分享

发表评论

请输入评论内容...

请输入评论/评论长度6~500个字

暂无评论

暂无评论